¡Tu carrito está actualmente vacío!

Investigadores de la Universidad de California, Berkeley, desarrollaron VideoMimic, un sistema que entrena robots humanoides para realizar tareas complejas simplemente observando videos comunes de personas.

La investigación representa un paso importante hacia la creación de robots que puedan adaptarse a entornos reales sin necesidad de una programación manual intensiva.

Imitación contextual del entorno

El enfoque de VideoMimic se basa en la idea de que los humanoides pueden aprender de la misma manera que lo haría un ser humano: observando y copiando.

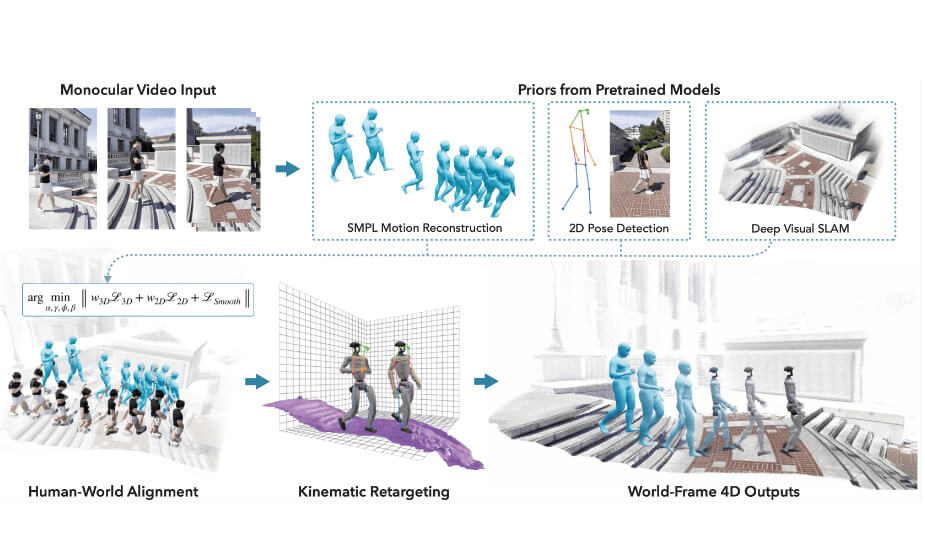

A partir de un solo video monocular, el sistema reconstruye tanto los movimientos humanos en 4D como la geometría detallada del entorno.

Luego, transfiere estos movimientos a un robot humanoide, utilizando un simulador que convierte la escena en una malla tridimensional.

Con esta información, se entrena una política de control corporal completa, sensible al contexto del entorno.

Resultados en el mundo real con VideoMimic

Los investigadores demostraron que un solo modelo de control concede a los humanoides realizar una amplia gama de acciones en entornos reales:

- Subir y bajar escaleras: El robot muestra una locomoción segura y adaptable, ajustándose a distintas estructuras.

- Sentarse y levantarse: El sistema le permite al robot adaptarse a sillas y bancos de diferentes formas y alturas, replicando movimientos humanos suaves.

- Recorrido por terrenos difíciles: El humanoide navega con eficacia por superficies irregulares, pendientes y pequeños obstáculos.

Una política, múltiples capacidades

A diferencia de otros enfoques que requieren políticas diferentes para cada tarea, VideoMimic logra todo desde una sola política de control condicionada por el entorno.

Por ahora no utiliza información visual RGB directamente, el sistema deja abierta la posibilidad de incorporar perspectivas en primera persona para una mayor autonomía.

La imitación como clave para el control humanoide

VideoMimic ofrece una solución escalable y eficiente para enseñar habilidades complejas a robots humanoides, utilizando simplemente videos cotidianos como fuente de aprendizaje.

Con este modelo, el entrenamiento de robots en entornos del mundo real podría volverse más accesible, acelerando su integración en actividades cotidianas y laborales.

Tagged in :

Más entradas

IA y NASA: Predicción de eventos solares

.

La inteligencia artificial ayuda a predecir eventos solares y proteger satélites de posibles interrupciones.

Google renueva Play Store con IA y nuevas funciones

.

Google anunció una importante actualización de su Play Store, orientada a mejorar la interacción de sus más de 4 mil millones…