¡Tu carrito está actualmente vacío!

Más de 2,600 líderes y expertos tecnológicos han firmado una carta abierta instando a una pausa temporal en el desarrollo de la inteligencia artificial (IA) por temor a «riesgos profundos para la sociedad y la humanidad».

La carta fue publicada por el Future of Life Institute (FOLI) de Estados Unidos el 22 de marzo. La institución llamó a todas las empresas de IA a «pausar inmediatamente» el entrenamiento de sistemas de IA más poderosos que GPT-4 durante al menos seis meses, compartiendo preocupaciones de que «la inteligencia competitiva humana puede representar riesgos profundos para la sociedad y la humanidad», entre otras cosas.

Las principales preocupaciones están si las máquinas podrían inundar los canales de información, potencialmente con «propaganda y falsedades», y si las máquinas «automatizarán» todas las oportunidades de empleo.

La misiva afirma que existe una «carrera desenfrenada» entre las empresas de IA para desarrollar IA más poderosa, que «nadie, ni siquiera sus creadores, puede entender, predecir o controlar de manera confiable».

La pausa temporal de la IA solo duraría seis meses

El FOLI sugirió que los esfuerzos empresariales de estas empresas de IA podrían llevar a una amenaza existencial, y propuso que si no se implementa una pausa temporal en el desarrollo de IA, los gobiernos deberían intervenir con una moratoria.

La carta también estuvo respaldada por líderes de la industria, como Elon Musk, Steve Wozniak y Yuval Harari.

Esta en sí misma no pide un freno permanente en el desarrollo de la IA, sino una pausa temporal en el desarrollo de sistemas de IA más poderosos que el GPT-4.

Los riesgos del avance de la IA

La preocupación es que la IA avanzada pueda representar un riesgo profundo para la sociedad y la humanidad si no se aborda adecuadamente.

La tecnología de inteligencia artificial ha avanzado significativamente en las últimas décadas y ya está siendo utilizada en una variedad de aplicaciones, desde la atención médica hasta la conducción autónoma.

Sin embargo, a medida que la IA se vuelve más avanzada y capaz de tomar decisiones por sí sola, surgen preocupaciones sobre quién será responsable si algo sale mal.

Algunos expertos temen que la IA pueda ser utilizada para crear armas autónomas, que puedan actuar sin la intervención humana, lo que podría llevar a una carrera armamentística.

Otros temen que la IA pueda ser utilizada para manipular a las personas a través de la propagación de desinformación y propaganda, socavando la democracia y la estabilidad social.

La carta abierta es más una llamada a la reflexión y la prudencia en el desarrollo de la IA, a la necesidad de que los responsables políticos y los expertos en tecnología trabajando en equipo para abordar los riesgos y los desafíos que plantea esta tecnología.

Tagged in :

Más entradas

Nano Banana: Nueva forma en edición de imágenes de Google

.

Google ha dado un paso adelante en la edición de imágenes con IA gracias al lanzamiento de Gemini 2.5 Flash Image,…

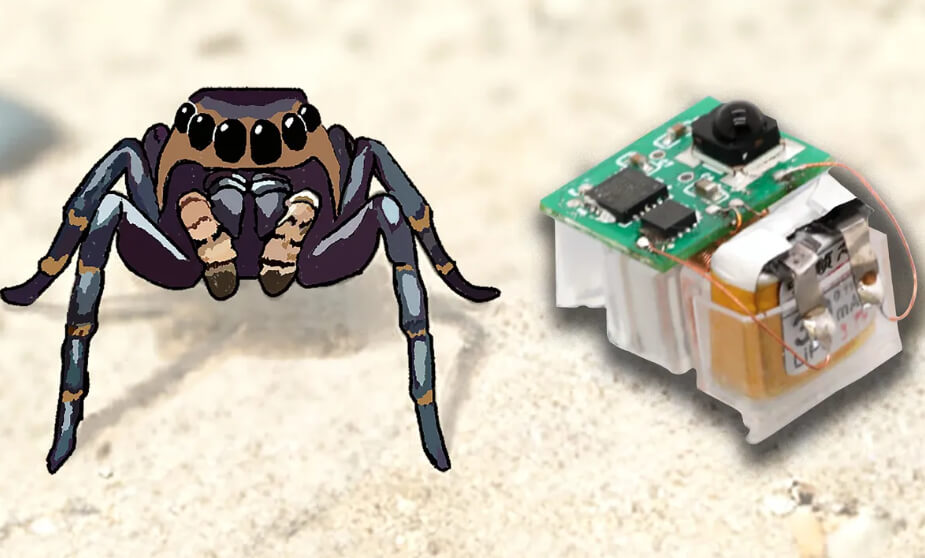

Actuadores flexibles dan agilidad a los robots insecto

.

Los robots insecto representan una alternativa para tareas de búsqueda y rescate, así como para la inspección de infraestructuras.

Genie 3: Nuevo avance en mundos virtuales

.

DeepMind ha presentado Genie 3, un modelo de “world model” que puede generar entornos 3D interactivos en tiempo real a partir…