¡Tu carrito está actualmente vacío!

Meta ha presentado SeamlessM4T, un modelo de inteligencia artificial (IA) multimodal diseñado para traducciones de voz y texto.

Este nuevo modelo utiliza una red neuronal capaz de procesar tanto información de texto como de audio, permitiéndole realizar traducciones en varias modalidades: de texto a voz, de voz a texto, de voz a voz y de texto a texto, y lo hace en «hasta 100 idiomas», según indicó la empresa.

El propósito detrás de esta innovación es facilitar la comunicación efectiva entre personas que hablan diferentes idiomas.

En línea con la enfoque de apertura que ha mantenido Meta hacia la IA, la compañía ha lanzado SeamlessM4T bajo una licencia de investigación (CC BY-NC 4.0), lo que permite a los desarrolladores construir y trabajar sobre este avance.

También han lanzado SeamlessAlign, que la empresa describe como «el mayor conjunto de datos de traducción multimodal abierta hasta la fecha», con un impresionante total de 270,000 horas de alineaciones de voz y texto extraídas.

Esta colección masiva de datos probablemente impulsará el entrenamiento de futuros modelos de IA de traducción desarrollados por otros investigadores.

Dentro de las características resaltadas por Meta en su blog promocional, la empresa destaca que SeamlessM4T puede llevar a cabo diversas funciones.

Estas incluyen el reconocimiento de voz (convirtiendo el habla en audio en texto), traducción de voz a texto (transformando el audio hablado en un idioma en texto), traducción de voz a voz (tomando audio de voz y generando audio de voz traducido), traducción de texto a texto (similar a cómo funciona Google Translate) y traducción de texto a voz (tomando texto y generando una voz traducida en otro idioma).

Cada función de traducción de texto es compatible con casi 100 idiomas, mientras que las funciones de salida de voz admiten alrededor de 36 idiomas.

En la presentación de SeamlessM4T, Meta hace referencia al Babel Fish, un concepto ficticio de la serie de ciencia ficción clásica de Douglas Adams.

El Babel Fish es un pez que, cuando se coloca en el oído de una persona, puede traducir instantáneamente cualquier idioma hablado.

¿Cómo se entrenó este modelo multimodal de Meta?

Según la documentación de investigación de Seamless4MT, los científicos de Meta crearon un amplio conjunto de datos multimodal compuesto por traducciones de voz alineadas automáticamente, con más de 470,000 horas, llamado SeamlessAlign.

Luego, seleccionaron un subconjunto de este conjunto, que consistía en 406,000 horas, que incluían datos etiquetados y pseudoetiquetados por seres humanos.

Si bien Meta no proporciona una gran cantidad de detalles sobre el origen de sus datos de entrenamiento, revelan que los datos de texto provienen del mismo conjunto de datos desplegado en NLLB, que contiene oraciones extraídas de fuentes como Wikipedia, noticias, discursos y otros recursos, traducidos por profesionales.

En cuanto a los datos de voz utilizados en SeamlessM4T, estos se recopilaron de «4 millones de horas de audio sin procesar provenientes de un repositorio web de acceso público», con 1 millón de esas horas siendo en inglés, según el informe de investigación.

Aunque Meta no es la primera compañía en incursionar en herramientas de traducción basadas en aprendizaje automático, siendo Google Translate un ejemplo temprano desde 2006, la reciente atención se ha centrado en el procesamiento de audio.

En septiembre, OpenAI lanzó su propio modelo de traducción de voz a texto de código abierto, llamado Whisper, que demuestra un alto nivel de precisión al reconocer y traducir el habla en audio. SeamlessM4T sigue esta tendencia al ampliar la traducción multimodal a una gama más amplia de idiomas.

Además, Meta enfatiza que su «enfoque de sistema único» para SeamlessM4T, que utiliza un solo modelo de IA en lugar de una cadena de modelos, como se ha visto en enfoques previos de procesamiento de audio de Meta, reduce errores y aumenta la eficiencia del proceso de traducción.

Para aquellos interesados en conocer más detalles técnicos sobre el funcionamiento de SeamlessM4T, la página web de Meta ofrece información detallada.

También el código y los pesos (archivos de red neuronal entrenada) se encuentran disponibles en Hugging Face.

Con información de Ars Technica.

Tagged in :

Más entradas

Wacom impulsa a Blender con gran donación

.

El fabricante japonés de tabletas gráficas Wacom ha dado un paso decisivo en el impulso del software de creación 3D de…

Nano Banana: Nueva forma en edición de imágenes de Google

.

Google ha dado un paso adelante en la edición de imágenes con IA gracias al lanzamiento de Gemini 2.5 Flash Image,…

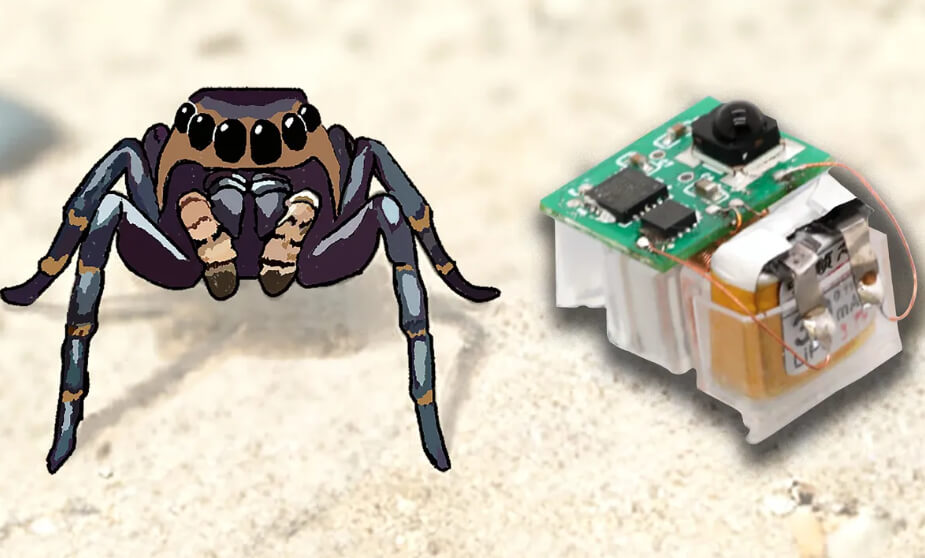

Actuadores flexibles dan agilidad a los robots insecto

.

Los robots insecto representan una alternativa para tareas de búsqueda y rescate, así como para la inspección de infraestructuras.